服务器托管显卡,未来数据中心的视觉革命

标题:GPU显卡在服务器托管中的未来与挑战,,随着人工智能、科学计算和医学影像等领域的飞速发展,GPU显卡服务器的作用日益凸显。苏州作为智能制造和人工智能示范城市,对高性能服务器的需求持续增长。本文将探讨GPU显卡服务器托管的未来趋势及其面临的挑战。,,一、GPU显卡服务器的重要性,1. GPU显卡服务器在AI和深度学习中的应用,- 加速数据处理和模型训练,- 提高图形渲染效率,2. A100和H800显卡的性能优势,- 高带宽和低延迟,- 增强计算能力,3. GPU服务器在科学计算中的角色,- 处理大规模数据集,- 支持复杂的模拟和仿真,,二、GPU服务器托管的挑战,1. 网络环境的稳定性要求,- 保证数据传输速度和稳定性,- 应对高流量下的带宽需求,2. 硬件配置的优化,- 确保CPU和内存满足计算需求,- 选择合适的存储解决方案,3. 数据中心的能效管理,- 实现绿色能源消耗,- 降低运营成本,4. 技术支持与维护,- 提供专业的运维团队,- 定期进行系统检查和维护,,三、苏州GPU显卡服务器案例分析,1. 苏州某智能创造公司的案例,- 展示GPU服务器在实际应用中的效果,- 反映市场需求和发展趋势,2. 胜网高电数据中心的实践,- 高标准设施和充足资源,- 专业化的运维团队和服务,,四、GPU显卡服务器在未来数据中心扮演着重要角色,但同时也带来一系列挑战。通过持续的技术创新和服务优化,可以推动GPU服务器托管服务向更高效、稳定的方向发展。

在数字时代,数据和信息的重要性日益增加,而作为存储、处理和传输数据的基础设施,服务器扮演着不可或缺的角色,随着技术的不断进步,服务器的性能也得到了显著的提升,其中显卡作为服务器的重要组件之一,其性能直接影响到整个系统的运行效率和用户体验,将服务器托管在显卡上,不仅是一种创新的解决方案,更是推动未来数据中心发展的关键因素,本文将探讨服务器托管显卡的概念、优势及面临的挑战,并展望未来可能的发展方向。

服务器托管显卡的概念与技术基础

所谓“服务器托管显卡”,是指在服务器内部集成高性能的图形处理器(GPU),以便直接进行图形渲染工作,从而减少数据传输的延迟,提高计算效率,这种配置方式使得服务器能够处理更为复杂的图形任务,如3D渲染、视频编辑、科学模拟等,GPU的并行计算能力使其成为处理大规模数据集的理想选择。

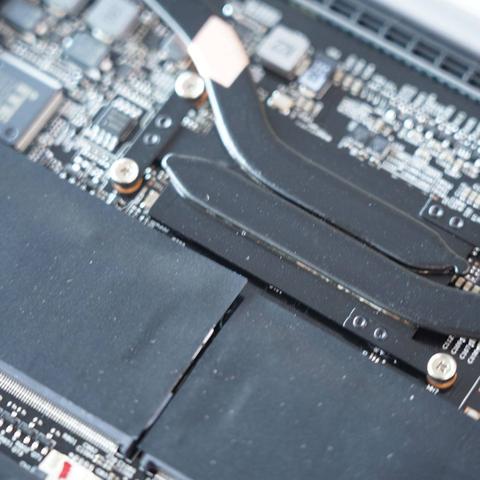

实现服务器托管显卡的技术关键在于高效的电源管理、热管理和散热解决方案,由于GPU在工作时会产生大量热量,因此需要精心设计散热系统以维持系统的稳定性,为了确保足够的电源供应,还需要采用高能效比的电源模块。

优势分析

1、提升计算效率:通过将计算密集型任务交给GPU执行,可以大幅降低CPU的负载,从而加快数据处理速度。

2、降低延迟:GPU直接参与计算过程可以减少数据传输的时间,这对于实时交互应用尤为重要。

3、扩展性:服务器托管显卡提供了硬件层面的扩展性,允许用户根据需求升级GPU或添加更多GPU来增强系统能力。

4、成本效益:虽然初期投资相对较高,但由于其高效能和低能耗特性,长远来看可能更经济。

面临的挑战

尽管服务器托管显卡带来了许多潜在优势,但也存在一些挑战需要克服:

1、兼容性问题:不同的服务器制造商可能不提供兼容的GPU选项,这限制了用户选择的自由度。

2、性能瓶颈:在某些应用场景中,GPU的性能仍可能不足以满足所有需求,尤其是在对实时性有极高要求的场景下。

3、散热挑战:GPU在高负载下产生的热量可能导致系统过热,影响性能甚至导致故障。

未来发展展望

随着技术的发展,服务器托管显卡的未来充满了可能性,我们可以预见以下几点发展趋势:

1、标准化:随着行业标准的建立,将有更多的服务器制造商提供兼容的GPU选项,这将极大地促进这一概念的普及。

2、能效优化:新一代的GPU将更加注重能源效率,这将有助于降低整体系统的能耗,延长服务寿命。

3、人工智能集成:GPU的并行计算能力将与人工智能技术更加紧密结合,为机器学习、数据分析等领域带来革命性的变革。

4、边缘计算:随着物联网设备的增多,服务器托管显卡可能会更多地应用于边缘计算节点,以提供更快的数据处理速度和更低的延迟。

服务器托管显卡作为一种新兴的技术趋势,正在逐步改变数据中心的面貌,它不仅能够提高数据处理的效率和速度,还能为用户提供更加流畅和直观的应用体验,要充分发挥其潜力,还需要解决兼容性、性能和散热等关键技术问题,随着技术的不断进步和社会需求的不断增长,服务器托管显卡有望在未来的数字世界中扮演越来越重要的角色。

与本文知识相关的文章:

台州服务器托管服务商电话查询(专业服务器托管服务商联系方式)